微软自研AI模型MAI-Voice-1与MAI-1-preview重磅登场

- 科技资讯

- 2025-12-27

- 466

【导读】微软迅速跟进OpenAI的最新动态,于同日重磅推出两款自研AI大模型:语音模型MAI-Voice-1和通用模型MAI-1-preview。这位科技巨头的首款自研AI模型,其实际表现如何?引发行业高度关注。

就在OpenAI发布最新语音大模型之时,微软也亮出了自研的语音大模型!

微软AI掌门人、DeepMind联合创始人Mustafa Suleyman正式宣布:

微软AI正式推出MAI-Voice-1以及MAI-1-预览版!未来还将有更多内容陆续推出。

MAI-Voice-1语音模型效率卓越:单GPU可在秒级生成1分钟音频!通过Copilot即可轻松体验。

在Mustafa Suleyman看来,这是他体验过表现力最丰富、最自然的语音生成模型。

而MAI-1预览版模型是微软AI首个端到端内部训练的自研基础模型。

这标志着在多年依赖OpenAI模型之后,微软AI部门正式与OpenAI及整个行业展开正面竞争,也意味着微软在AI竞赛中,开始掌握更多主动权。

在接受采访时,Suleyman 表示:「微软是世界上最大的公司之一。我们必须具备内部能力,来打造世界最强的模型。」

MAI-Voice-1:核心能力深度解析

微软官方指标中最引人注目的,是「单卡<1秒,生成1分钟音频」。

这使其成为当前罕见的极致低延迟TTS/对话式语音生成系统之一。

此外,语音的自然度和表现力也是重点,覆盖了单人叙述与多说话人对话两种常见内容形态。

新闻播报、播客对谈、故事讲述、冥想引导等,各类场景都能胜任。

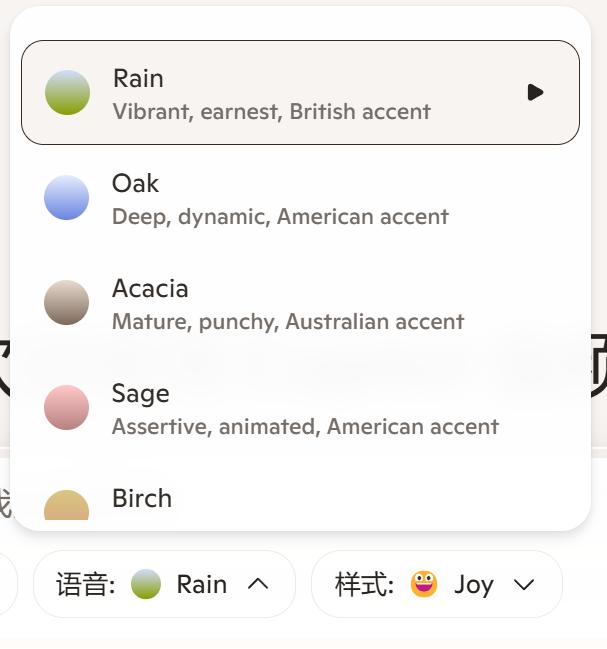

用户可以选择9种不同语音:

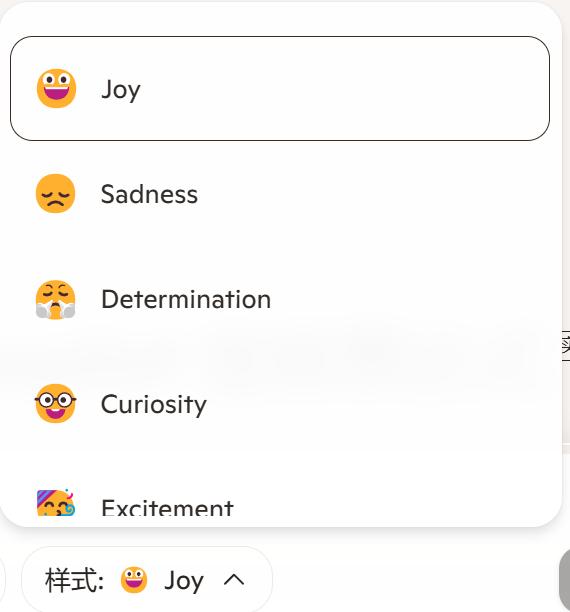

还可选择多达31种不同情绪和播报场景:

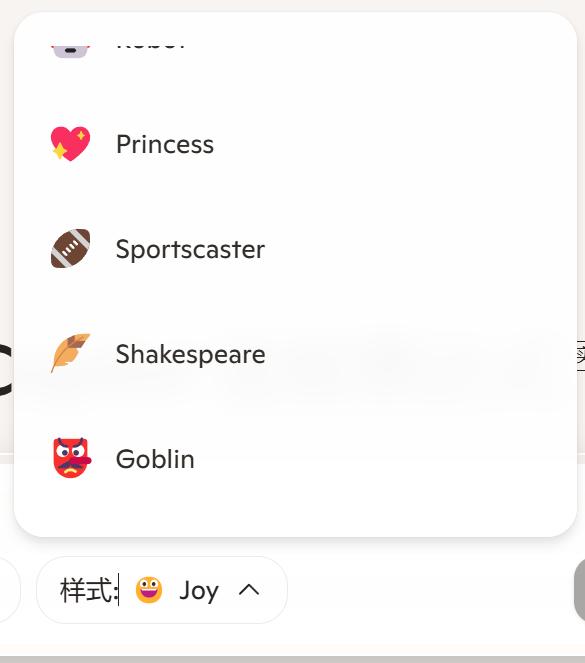

甚至可以让模型扮演激情四射的体育解说员,点燃听众情绪:

落地应用方面,用户可通过Copilot Labs,在Copilot Daily中以AI主播播报要闻、在Copilot Podcasts生成播客式讨论,Copilot Labs 提供可自定义内容和风格的演示版。

以下是两段该模型生成的语音示例,满分5分您会打几分?是否还残留AI痕迹?欢迎在评论区分享您的评测意见。

微软与OpenAI:合作与竞争并存

长期以来,微软主要依赖OpenAI的AI模型,为核心产品赋能。

OpenAI当前估值约5000亿美元,微软投资超130亿美元,而OpenAI也依靠微软云基础设施运行模型。

但微软现已宣布:「未来几周,将在Copilot部分文本任务中逐步推出MAI-1-preview,以收集用户反馈并持续优化。」

目前,微软仍在Bing、Windows 11等产品中使用OpenAI模型。

然而双方关系正逐渐微妙变化。

去年,微软在年度财报中将OpenAI正式列为竞争对手,此前名单仅包含亚马逊、苹果、谷歌和Meta等巨头。

近几个月,OpenAI也开始转向CoreWeave、谷歌和甲骨文等其他云服务商,以满足算力激增需求。

与OpenAI同期发布语音模型:战略意图何在

就在昨日,OpenAI也发布了最新语音生成大模型GPT-Realtime,集成于Realtime API中。

该模型在语音自然性、情感丰富度和低延迟响应上大幅提升,支持一句话内语调语言无缝切换,还具备工具调用和指令跟随能力。

微软为何选在此刻发布新模型?

此次发布虽仅含语音模型和预览版通用模型,但释放的信号至关重要。

其一,语音成为AI助手关键战场。

MAI‑Voice‑1的效率和表现力有望推动语音助手升级为「数字伙伴」。

富有情感和个性的数字伙伴,正成为Grok等模型发力的新突破点,潜力巨大。

其二,OpenAI不再是唯一选项。

大模型发展进入「百模大战」,各巨头竞相推出自研产品。

微软此举既是对OpenAI合作的补充,也为自身在与OpenAI的商业谈判中增添了重要筹码。

其三,MoE架构成大模型新趋势。

MAI‑1‑preview采用MoE架构,训练规模适中但注重指令遵循和响应效率,平衡性能与成本。

随着LLM细分应用增多,多专家模型将成为重要方向。

其四,生态开放值得期待。

微软表示将在Copilot及第三方测试平台开放模型,鼓励开发者反馈。

在媒体采访中,Mustafa Suleyman表示:

人工智能不仅是科技的未来,更是未来几十年商业运行和价值创造的核心。

因此,研发最强模型不仅是技术追求,更是微软作为企业的战略必然。

我们必须拥有自己的核心能力。

14个月前,他和团队从Inflection加入微软后,便全力推进此事。

如今,微软终于发布了两款自研模型。

Suleyman强调,微软未来将继续使用OpenAI模型和开源模型,但关键在于「编排器」(orchestrator)。

这是一种模型调度系统,能根据任务自动选择合适模型,类似「路由器」。

他认为,这种编排能力将成为微软的重要知识产权。

外界普遍猜测,微软推出自研模型是否意味与OpenAI关系降温?

对此,Suleyman回应:

我们的目标是进一步深化与OpenAI的合作,保持长期良好伙伴关系。

双方合作非常成功,未来相信仍会持续。

微软自研大模型的幕后故事

微软AI透露:「MAI-1-preview是MoE模型,使用约1.5万张NVIDIA H100 GPU进行了预训练和后训练。」

在LMArena文本任务榜单上,MAI-1排名第13,落后于DeepSeek、谷歌、OpenAI和xAI等主要AI玩家的模型。

相比之下,xAI的Grok模型动用了超过10万张同类芯片。

微软AI用较小规模集群,也训练出了强大模型。

Suleyman认为自研新模型表现远超硬件规模,可与世界最强模型媲美,且刚起步调优。

一旦模型投入应用并收集反馈,迭代后性能将显著提升。

对微软AI来说,这只是开始。

微软AI算力充沛,已使用全球最大数据中心之一,并配备Nvidia下一代GB-200芯片,研发下一版本模型。

此外,他们还有庞大五年规划,将持续投资算力。

规模重要,但效率同样关键。

这意味着需精选高质量训练数据,确保每次浮点运算和GPU迭代发挥最大价值。

训练模型的核心能力,正日益成为「工艺」——选对数据,避免算力浪费于无效token。

Suleyman 表示,公司利用了开源社区技术,使有限资源发挥更大作用。

这是微软首次完整端到端训练的大模型。研发过程中,团队面临不少挑战。

Suleyman坦言:「构建这种规模集群、训练庞大数据,需要持续调试、迭代和耐心。这是每家实验室的共同难题。」

他对团队表现非常满意:「我们学到了很多,积累了足够经验以打造更多优秀模型。」

他比喻为「转动飞轮」:一旦模型研发进入正循环,每一代都推动下一代更快成长。

此前,Suleyman在Inflection和DeepMind虽有经验,但算力规模较小,GPU未达十万张级别。

这次首个模型成功,他认为关键在于文化:

优秀文化吸引优秀人才,优秀团队才能构建优秀模型。

最终,团队价值观也会自然注入模型和产品中。

Suleyman还透露已在开发下一模型:规模更大,训练架构有新调整。

一切已启动,未来几个月和几年将有更多值得期待。

参考资料:

https://copilot.microsoft.com/labs/audio-expression

https://microsoft.ai/news/two-new-in-house-models/

https://x.com/mustafasuleyman/status/1961111770422186452

本文由主机测评网于2025-12-27发表在主机测评网_免费VPS_免费云服务器_免费独立服务器,如有疑问,请联系我们。

本文链接:https://www.vpshk.cn/20251213058.html